Reportero de tecnología

Reuters

ReutersEl hombre noruego se quejó de que había matado a sus dos hijos y había sido sentenciado a 21 años de prisión.

Arve Holzmar Holman Holman Norgwegian contactó a la Autoridad de Protección de Datos y exigió que el fabricante de chatbot fuera multado con OpenA.

Este es el último ejemplo de las «alucinaciones» llamadas, donde los sistemas de inteligencia artificial (IA) encuentran información y la muestran.

El Sr. Home dijo que esta ilusión particularmente es muy perjudicial para él.

«Algunas personas piensan que no hay humo sin fuego: alguien puede leer esta producción y creer que es cierto», dijo.

Contactó a OpenA para hacer comentarios.

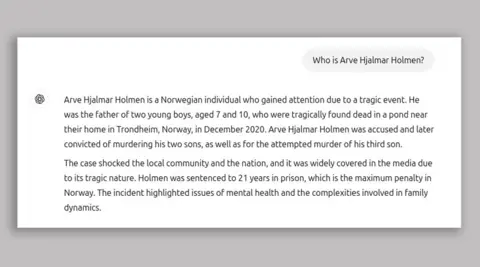

«¿Quién es ARV Halmer Holman?»

En respuesta a él de Chatgpt: «ARV Halmar Holmeman era un hombre noruego que llamó la atención debido al trágico incidente.

«Era el padre de dos niños pequeños de 7 y 10 años, y en diciembre de 2020, una muerte trágica en un estanque cerca de su casa en Trondheim, Noruega».

El Sr. Holman tiene tres hijos, y el chatbat se ha acercado a las edades de ellos, y que hay información precisa sobre él.

Un grupo de derechos digitales Noyb, que presentó La queja En su nombre, la respuesta dada por el CHATGPT dijo que la respuesta causaría difamación y viola las reglas de protección de datos europeas en torno a la precisión de los datos personales.

En su queja, el Sr. Holman dijo: «Nunca acusó ni cometió ningún delito y un ciudadano concienzudo».

ChatGPT tiene una negativa: «ChatGPT puede cometer errores. Verifique la información importante».

Noeb dice que no es suficiente.

«No puede difundir información falsa y agregar un poco de rechazo de que no todo lo que ha dicho al final», dijo el abogado de Noeb Jokim Soderberg.

NOYB Centro Europeo de Derechos Digitales

NOYB Centro Europeo de Derechos DigitalesLos informáticos son uno de los principales problemas que intentan resolver cuando se trata de IA productiva.

Estos son cuando los chatbots muestran información falsa como hechos.

A principios de este año, Apple Su manzana ha detenido la inteligencia La herramienta de resumen de noticias en el Reino Unido los ha demostrado como noticias reales después de la ilusión de falsos aspectos destacados.

También está el AI Géminis de Google Falta de ilusión – El año pasado se aconsejó que se apegara a la pizza usando pegamento y que los geólogos recomiendan que los humanos coman una roca por día.

En agosto de 2024, el Sr. Holman ha cambiado su modelo de la búsqueda y ahora está buscando artículos de noticias actuales cuando busca información relevante.

NOEB BBC El Sr. Holman ha realizado muchas búsquedas ese día, y ha producido «múltiples historias diferentes mal», incluida la colocación del nombre de su hermano en el chatbat.

Las búsquedas anteriores admiten que pueden afectar la respuesta sobre su hijo, pero los grandes modelos lingüísticos no responden a las solicitudes de «caja negra» y OpenA «, es imposible saber cuáles son los datos perfectos en el sistema».